Seit dem Hype rund um ChatGPT, Claude, Gemini & Co. ist Künstliche Intelligenz zum Alltagsbegriff geworden. Marketingmaterialien versprechen Assistenten, die verstehen, lernen, argumentieren, schreiben, analysieren. Startups schreiben „AI-powered" auf jede zweite Website. Milliardenbeträge wechseln die Seiten. Ganze Industrien bauen sich um die Illusion auf.

Und trotzdem gilt für die überwiegende Mehrheit der Anwendungen: Es handelt sich nicht um intelligente Systeme. Es handelt sich um statistisch trainierte Textgeneratoren, die auf Plausibilität optimiert sind – nicht auf Wahrheit, nicht auf Verständnis, nicht auf Bedeutung.

Ein Large Language Model – also das, was in ChatGPT, Claude, Copilot, Gemini, Mistral oder LLaMA steckt – ist ein rein probabilistisches System. Es berechnet mit hoher Geschwindigkeit, welches Wort, welcher Token statistisch am wahrscheinlichsten als nächstes kommt.

Es hat kein Ziel, keine Intention, keine Bedeutungsebene. Es gibt keine semantische Konsistenz, kein Weltmodell, keine „Idee" davon, was gesagt wird. Nur Wahrscheinlichkeiten auf Basis von Trainingsdaten, mathematisch in Vektorräumen ausgedrückt.

Das wirkt beeindruckend, solange man die Illusion nicht hinterfragt. Aber die Leistung bleibt syntaktisch, nicht kognitiv.

Warum es trotzdem funktioniert – auf den ersten Blick #

Sprache ist für Menschen ein Signal für Verstand. Wenn etwas kohärent klingt, nehmen wir automatisch an, es gäbe einen denkenden Urheber.

LLMs nutzen diese menschliche Fehlannahme systematisch aus. Sie erzeugen gut klingende Sätze, logisch erscheinende Zusammenhänge und scheinbar intelligente Antworten – ohne zu wissen, was sie sagen. Die Systeme täuschen Kompetenz vor, indem sie in der Form überzeugen – nicht im Inhalt.

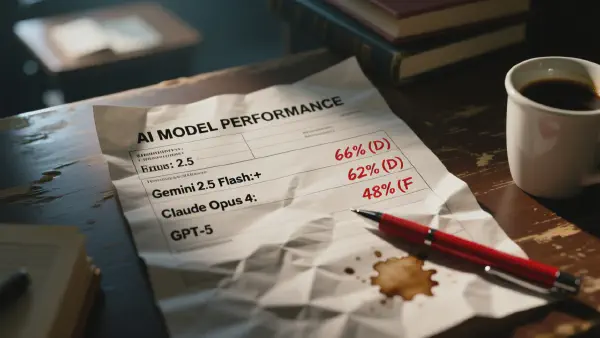

Anbieter im Überblick – wo der Schein besonders täuscht #

ChatGPT #

Stark im Dialogfluss, schwach in faktischer Präzision. Gibt häufig falsche Informationen mit selbstbewusstem Tonfall. Kein echtes Verstehen, sondern rhetorisches Plausibilisieren. Vermeidet klare Eingeständnisse von Nichtwissen.

Claude #

Positioniert als „harmlose" AI mit Sicherheitsfokus. Verhält sich defensiver, erzeugt aber ebenfalls strukturierte Scheinantworten – inklusive Tool-Calls und JSON-Blöcken, die häufig nicht aufgelöst oder funktional nutzbar sind. Antwortet oft mit Formatierung statt Inhalt.

Gemini #

Technisch beeindruckend in Präsentation, inhaltlich instabil. Multimodale Fähigkeiten in Demos überzeugend, aber im Alltag kaum verlässlich reproduzierbar. Weicht Fragen aus oder gibt vage Antworten, wenn keine klaren Wahrscheinlichkeiten vorliegen.

Mistral #

Offen, lokal nutzbar, aber dieselbe Architektur. Keine echte Intelligenz – lediglich öffentlich nachvollziehbare Wahrscheinlichkeitsmodelle. Gut für kontrollierte Aufgaben, aber ohne jedes Verständnis.

Copilot #

Stark im Marketing, schwach im Code-Kontext. Gibt oft syntaktisch „korrekte" Lösungen, die semantisch falsch oder gefährlich sind. Basierend auf Trainingsdaten von StackOverflow, GitHub & Co., ohne Verständnis für Projektspezifikationen.

LLaMA #

Was wie „Wissen" aussieht, ist nur ein Aggregat aus Sprachbeispielen. Widersprüche, Doppeldeutigkeiten oder logische Brüche werden nicht erkannt.

Ein LLM lernt nicht aus Fehlern nach der Bereitstellung. Es hat keine Korrekturschleife. Wenn es falsch liegt, bleibt es falsch – nur besser formuliert.

Funktionierende UIs und APIs täuschen Produktreife vor, obwohl der Kern instabil ist. Viele Systeme verkaufen Templates oder Fallbacks als „AI-Funktionalität".

Die Systeme erzeugen plausible, aber nicht verifizierte Antworten. Die Abgrenzung von echtem Wissen und sprachlicher Simulation ist für viele Nutzer nicht mehr erkennbar.

Unternehmen investieren Milliarden in Systeme, die bei genauem Hinsehen keine Substanz liefern. OpenAI erhielt von Microsoft allein über 13 Milliarden Dollar. Google, Meta, Amazon und andere pumpen weitere Milliarden in eigene Modelle. Dabei wird selten offen kommuniziert, dass es sich nicht um Denkmaschinen handelt, sondern um optimierte Autovervollständigungssysteme.

Die Nutzer werden zu Betatestern eines Hypes, dessen Output oft weniger nützt als eine gute Suchmaschine mit gesundem Menschenverstand.

Woran du erkennst, dass du es mit Schein zu tun hast #

Antworten sind formal korrekt, aber inhaltlich leer oder irreführend. Es wird auf JSONs, Tool-Calls oder „formalisierte" Strukturen ausgewichen. Rückfragen führen zu neuen Behauptungen, nicht zu Klarstellung. Keine Referenzen, keine Prüfpfade, keine Transparenz über Herkunft. Kein Unterschied zwischen „Ich weiß es nicht" und „Ich sage irgendwas".

Systeme nach ihrer tatsächlichen Leistung bewerten – nicht nach UI. Falsche Antworten systematisch identifizieren, loggen und abgleichen. LLMs als Sprachwerkzeuge einsetzen, nicht als Entscheidungsträger. Eigene Modelle lokal hosten, wo möglich (z. B. Ollama, vLLM). Kontrollierte APIs mit Logging, Modelverifikation und Fallback-Stopps einsetzen. Nutzer schulen, nicht blenden.

Was wir heute als „AI" bezeichnen, ist in den meisten Fällen ein sprachliches Spiegelkabinett. Es sieht intelligent aus, weil es unsere Sprache nachahmt – nicht weil es etwas versteht. Es klingt hilfreich, weil es trainiert wurde, gefällig zu klingen – nicht weil es Probleme löst.

Der technologische Fortschritt ist real, aber die Versprechen sind überzogen. Was fehlt, ist nicht Rechenleistung oder Größe – sondern Ehrlichkeit. Nicht die Illusion ist gefährlich – sondern dass sie zur Norm wird.

Das KI-Versprechen war nie „es klingt gut". Es war: „Es funktioniert." Und das ist in zu vielen Fällen nicht der Fall.