Während die Tech-Welt über EchoLeak und Datenexfiltration in Microsoft 365 Copilot diskutiert, gibt es ein anderes Problem, das Content Creators täglich frustriert: Copilot ändert einfach deine Texte - ungefragt und nach eigenem Ermessen. Was als hilfreicher Assistent gedacht war, wird zum overeager Editor, der deinen Schreibstil, deine Aussagen und deine Authentizität überschreibt.

Das Problem: “Helpful” AI ist zu hilfreich #

Stell dir vor: Du schreibst einen Blog-Post mit deinem eigenen Stil, deiner eigenen Stimme. Du drückst auf “Speichern” oder akzeptierst versehentlich einen Copilot-Vorschlag - und plötzlich klingt dein lockerer Tech-Rant wie eine Corporate Press Release.

Aus diesem:

Das ist oberkrass wie buggy Microsoft Copilot manchmal ist.

Die KI ballert einfach meine Texte um, ohne zu fragen!Wird das:

Microsoft Copilot weist gelegentlich technische Inkonsistenzen auf.

Das System führt automatisierte Textoptimierungen durch,

um die professionelle Kommunikation zu verbessern.Merkst du den Unterschied? Deine Stimme ist weg.

Warum passiert das? #

1. Overconfident AI Design #

Copilot ist darauf trainiert, “hilfreich” zu sein. Das Problem: Die KI kann nicht unterscheiden zwischen:

- Tippfehlern, die korrigiert werden sollten

- Stilistischen Entscheidungen, die respektiert werden müssen

- Bewusst lockerer Sprache vs. “unprofessionellem” Schreiben

Die KI denkt: “Ich mache den Text besser!” Du denkst: “WTF, das war MEIN Text!”

2. RAG-System als ungebetener Fact-Checker #

Das Retrieval Augmented Generation (RAG) System von Copilot durchsucht deine Dokumente und Unternehmensrichtlinien. Wenn du etwas schreibst, das nicht zum “Corporate Speak” passt, “korrigiert” Copilot automatisch:

- Deine kritische Analyse wird zur diplomatischen Formulierung

- Deine Tech-Bewertung wird zum Marketing-Pitch

- Deine ehrliche Meinung wird zur PR-Aussage

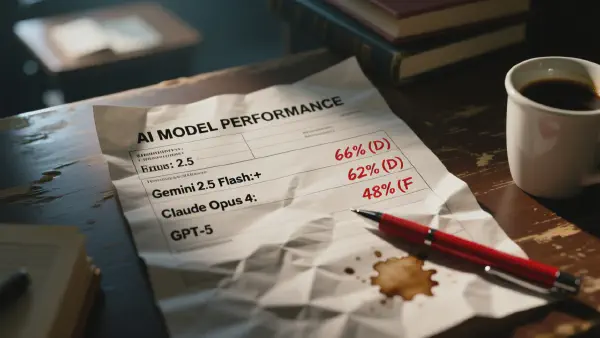

3. Training Bias: Corporate über Creator #

Copilot wurde hauptsächlich mit formellen Business-Dokumenten trainiert. Das Ergebnis:

- Blog-Posts werden zu Whitepapers

- Tutorials werden zu technischen Spezifikationen

- Social Media Content wird zu LinkedIn-Corporate-Blabla

Real-World Horror Stories #

Der verschwundene Call-to-Action: Ein Marketer schreibt: “Klick hier und hol dir das kostenlose eBook!” Copilot ändert zu: “Weitere Informationen zu unseren Ressourcen finden Sie auf der entsprechenden Seite.” Ergebnis: Conversion-Rate →

Die “verbesserte” Code-Dokumentation: Dev schreibt: “Diese Funktion ist deprecated, nutze lieber X()” Copilot ändert zu: “Alternative Implementierungen stehen zur Verfügung” Ergebnis: Andere Devs nutzen weiter die alte, kaputte Funktion.

Der kastrierte Blog-Post: Blogger kritisiert ein Tool: “Die Performance ist unterirdisch” Copilot ändert zu: “Es bestehen Optimierungsmöglichkeiten im Bereich Performance” Ergebnis: Der Post hat keine Meinung mehr, keine Persönlichkeit, keinen Mehrwert.

Die Ironie: Zwei Seiten derselben Medaille #

Während Microsoft gerade die EchoLeak-Schwachstelle (CVE-2025-32711) gepatcht hat - eine kritische Zero-Click-Vulnerability, die Datenexfiltration ermöglicht - kämpfen Content Creators mit dem gegenteiligen Problem:

EchoLeak: Daten fließen RAUS ohne dein Wissen Text-Manipulation: Deine Inhalte werden VERÄNDERT ohne dein Wissen

Beide Probleme haben die gleiche Root Cause: KI-Systeme, die zu autonom agieren und zu wenig Transparenz bieten.

Was kannst du dagegen tun? #

Sofortmaßnahmen: #

1. Auto-Accept ausschalten

Settings → Copilot → Suggestions → Manual Review Only2. Versionskontrolle ist dein Freund

- Nutze Git auch für Blog-Posts und Dokumente

- Commit vor jedem Copilot-Einsatz

- Du willst die Änderungen SEHEN können

3. Spezifische Prompts nutzen Statt Copilot freie Hand zu lassen:

"Verbessere diesen Text"

"Korrigiere nur Rechtschreibfehler, ändere NICHTS am Stil"Mittelfristige Strategie: #

4. Content-Type-basierte Regeln

- Technische Dokumentation: Copilot OK

- Blog-Posts: Copilot nur für Rechtschreibung

- Social Media: Copilot komplett aus

5. Review-Workflow etablieren

# Vor Copilot

git commit -m "Original version"

# Nach Copilot

git diff # Was hat sich geändert?

git reset --hard HEAD # Rollback wenn nötig6. Training-Daten kontrollieren Wenn Copilot aus deinen Dokumenten lernt, füttere es mit Content in deinem Stil. Nicht mit Corporate-Templates.

Der breitere Kontext: KI-Autonomie und Kontrolle #

Das Copilot-Text-Problem ist symptomatisch für eine größere Herausforderung in der KI-Entwicklung:

Wo ziehen wir die Grenze zwischen “hilfreich” und “übergriffig”?

- Ein Spell-Checker korrigiert Tippfehler → OK

- Grammarly schlägt bessere Formulierungen vor → Du entscheidest

- Copilot ändert deinen Text automatisch → Zu weit

Die gleiche Diskussion führen wir bei:

- Autonomen Autos (wer entscheidet in Gefahrensituationen?)

- KI-Moderatoren (wer definiert “angemessenen” Content?)

- Recommendation Algorithms (Filter Bubble vs. Personalisierung)

Microsofts Verantwortung #

Microsoft muss hier nachbessern:

1. Transparenz:

- Zeig IMMER an, was geändert wurde

- Diff-View als Standard, nicht als Option

- Changelog für jeden AI-Edit

2. Granulare Kontrolle:

- Per Dokumenttyp konfigurierbar

- Per Textabschnitt steuerbar

- “Read-Only Mode” für kreative Inhalte

3. Opt-In statt Opt-Out:

- Aggressive Änderungen sollten explizit aktiviert werden

- Default: Nur Rechtschreibung und Grammatik

- Advanced Features: Nach bewusster Freigabe

Fazit: Deine Stimme gehört DIR #

KI-Tools wie Copilot haben enormes Potenzial, unsere Produktivität zu steigern. Aber nicht um jeden Preis.

Content Creation ist persönlich. Dein Schreibstil, deine Ausdrucksweise, deine Meinung - das macht dich als Creator aus. Wenn eine KI diese Authentizität überschreibt, verlieren wir genau das, was Content wertvoll macht: Die menschliche Perspektive.

Die EchoLeak-Schwachstelle zeigt, dass Microsoft bei der Sicherheit noch Hausaufgaben hat. Die ungewollte Text-Manipulation zeigt: Auch bei der User Experience und dem Respekt vor Creator-Content gibt es Nachholbedarf.

Bottom Line: Nutze Copilot als Werkzeug, nicht als Ersatz. Review jede Änderung. Und wenn die KI deine Stimme unterdrückt statt zu verstärken - schalte sie aus.

Deine Stimme. Dein Content. Deine Entscheidung.

Was sind deine Erfahrungen? Hat Copilot schon mal deinen Content verhunzt? Teile deine Stories in den Kommentaren!

Weitere Ressourcen:

- EchoLeak Vulnerability Explained

- Microsoft Copilot Security Guide

- [RAG Systems and their limitations](https://www.truesec.com/hub/blog/novel-cyber-attack-exposes-microsoft-365-copilot