Technik

Warum LLMs keine Intelligenz besitzen#

Was ist ein LLM?#

Ein Large Language Model (LLM) wie GPT-4 ist eine riesige statistische Maschine, die das wahrscheinlich nächste Wort in einem Satz auf Basis von Trainingsdaten vorhersagt.

Es denkt nicht. Es versteht nichts. Es vervollständigt lediglich Muster.

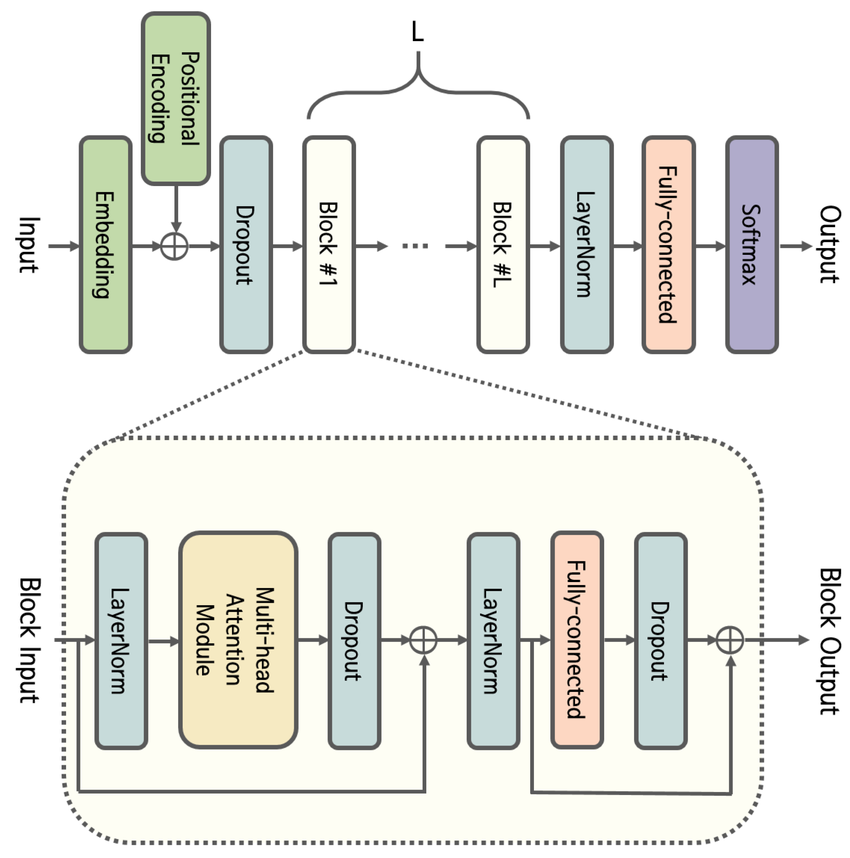

Wie funktionieren Transformer?#

- Eingaben (Tokens) werden in Vektoren umgewandelt.

- Selbst-Attention-Schichten berechnen die Beziehungen zwischen Tokens.

- Das Modell sagt das nächste Token mit statistischer Gewichtung voraus.

Es existiert kein Weltmodell, kein Bewusstsein, keine Logik-Instanz.

Beispiel:

Eingabe: „Die Katze saß auf der…“

Ausgabe: „…Matte“ (höchste statistische Wahrscheinlichkeit im Trainingskorpus)

Warum das keine Intelligenz ist#

- Kein Verständnis von Bedeutung.

- Kein Gedächtnis zwischen Sitzungen (außer extern implementiert).

- Keine Intention oder Ziel – nur Mustervervollständigung.

LLMs sind ELIZA auf Steroiden: sprachlich beeindruckend, skaliert – aber inhaltlich leer.

Analogie#

LLMs sind wie extrem schnelle Autovervollständiger mit riesigem Speicher – aber keine Denkmaschinen.

Quelle: ResearchGate, CC BY-NC-ND 4.0

Fazit#

LLMs sind mächtige Werkzeuge – aber sie als „intelligent“ zu bezeichnen, ist irreführend.

Diese Seite zeigt auf, wie dieses Etikett genutzt wird, um die öffentliche Wahrnehmung zu manipulieren.

Related Posts

- Grok ist im Arsch - Eine tiefgreifende Analyse seiner Grenzen und Fehler

- ChatGPT Search: Google-Killer oder Zensur-Upgrade? Ein kritischer Blick hinter die KI-Suchmaschine

- iPhone 16 AI: Apples Überwachungs-Revolution im Privacy-Gewand

- EU-US AI Safety Summit: Wie Regulierungs-Theater echte Innovation tötet

- EU AI Act: Der sanfte Würgegriff der Bürokratie - Wie Europa die KI-Innovation abwürgt